AI usa daños a la reputación profesional, sugiere el estudio

El uso de IA puede ser una espada de doble filo, según una nueva investigación de la Universidad de Duke. Si bien las herramientas generativas de IA pueden aumentar la productividad para algunos, también podrían dañar en secreto su reputación profesional.

El jueves, las actas de la Academia Nacional de Ciencias (PNA) publicado Un estudio que muestra que los empleados que usan herramientas de IA como Chatgpt, Tirary Géminis En el trabajo enfrentan juicios negativos sobre su competencia y motivación de colegas y gerentes.

«Nuestros hallazgos revelan un dilema para las personas que consideran adoptar herramientas de IA: aunque la IA puede mejorar la productividad, su uso conlleva costos sociales», escribe investigadores Jessica A. Reif, Richard P. Larricky Jack B. Soll de la Escuela de Negocios Fuqua de Duke.

El equipo de Duke realizó cuatro experimentos con más de 4,400 participantes para examinar las evaluaciones anticipadas y reales de los usuarios de la herramienta de IA. Sus hallazgos, presentados en un artículo titulado «Evidencia de una penalización de evaluación social por usar AI», revelan un patrón consistente de sesgo contra aquellos que reciben ayuda de la IA.

Lo que hizo esta penalización particularmente preocupante para los investigadores fue su consistencia entre la demografía. Descubrieron que el estigma social contra el uso de la IA no se limitaba a grupos específicos.

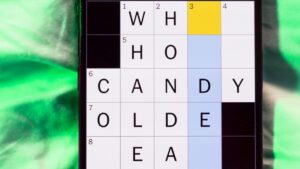

Fig. 1 del documento «Evidencia de una penalización de evaluación social por usar IA».

Crédito: Reif et al.

«Probar una amplia gama de estímulos nos permitió examinar si la edad, el género u ocupación del objetivo califican el efecto de recibir ayuda de AL en estas evaluaciones», escribieron los autores en el documento. «Descubrimos que ninguno de estos atributos demográficos objetivo influye en el efecto de recibir la ayuda de Al en las percepciones de pereza, diligencia, competencia, independencia o seguridad propia. Esto sugiere que la estigmatización social del uso de IA no se limita a su uso entre grupos demográficos particulares. El resultado parece ser normal».

El costo social oculto de la adopción de IA

En el primer experimento realizado por el equipo de Duke, los participantes imaginaron usar una herramienta de IA o una herramienta de creación de tablero en el trabajo. Reveló que aquellos en el grupo de IA esperaban ser juzgados como más perezosos, menos competentes, menos diligentes y más reemplazables que los que usan tecnología convencional. También informaron menos disposición a revelar su uso de IA para colegas y gerentes.

El segundo experimento confirmó que estos temores estaban justificados. Al evaluar las descripciones de los empleados, los participantes calificaron constantemente a aquellos que recibieron ayuda de IA como más perezoso, menos competente, menos diligente, menos independiente y menos segura que las que reciben ayuda comparable de fuentes que no son de AI o sin ayuda.