AI pronto podría consumir más electricidad que la minería de bitcoin y los países enteros

Una papa caliente: La industria world de IA está cruzando silenciosamente un umbral de energía que podría remodelar las redes de energía y los compromisos climáticos. Los nuevos hallazgos revelan que la electricidad requerida para ejecutar sistemas AI avanzados puede superar el notorio apetito energético de Bitcoin Mining a fines de 2025, con implicaciones que se extienden mucho más allá de las salas de juntas tecnológicas.

La rápida expansión de la IA generativa ha desencadenado un auge en la construcción del centro de datos y la producción de {hardware}. A medida que las aplicaciones de IA se vuelven más complejas y se adoptan más ampliamente, el {hardware} especializado que las alimenta, aceleradores de los gustos de Nvidia y AMD, ha proliferado a un ritmo sin precedentes. Este aumento ha impulsado una escalada dramática en el consumo de energía, y se espera que AI represente casi la mitad de todo el uso de electricidad del centro de datos para el próximo año, en comparación con aproximadamente el 20 por ciento en la actualidad.

Se espera que AI represente casi la mitad de todo el uso de electricidad del centro de datos para el próximo año, en comparación con aproximadamente el 20 por ciento en la actualidad.

Esta transformación ha sido analizada meticulosamente por Alex de Vries-Gao, un candidato a doctorado en el Instituto de Estudios Ambientales de Vrije Universiteit Amsterdam. Su investigaciónpublicada en la revista Joule, se basa en especificaciones de dispositivos públicos, pronósticos de analistas y revelaciones corporativas para estimar el volumen de producción y el consumo de energía de {hardware} de IA.

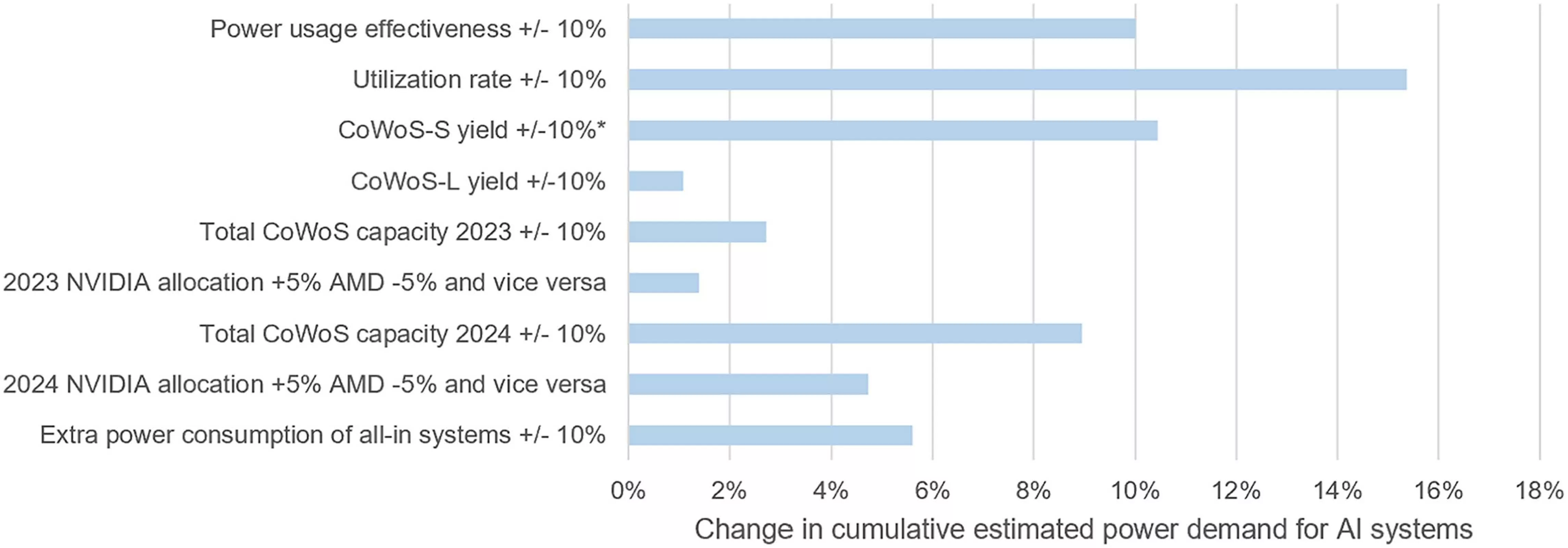

Debido a que las principales empresas tecnológicas rara vez revelan el consumo de electricidad de sus operaciones de IA, De Vries-Gao usó un método de triangulación, examinando la cadena de suministro para chips avanzados y la capacidad de fabricación de jugadores clave como TSMC.

Los números cuentan una historia clara. Cada acelerador NVIDIA H100 AI, un elemento básico en los centros de datos modernos, devour 700 vatios continuamente al ejecutar modelos complejos. Multiplique eso por millones de unidades, y el dibujo de energía acumulada se vuelve asombroso.

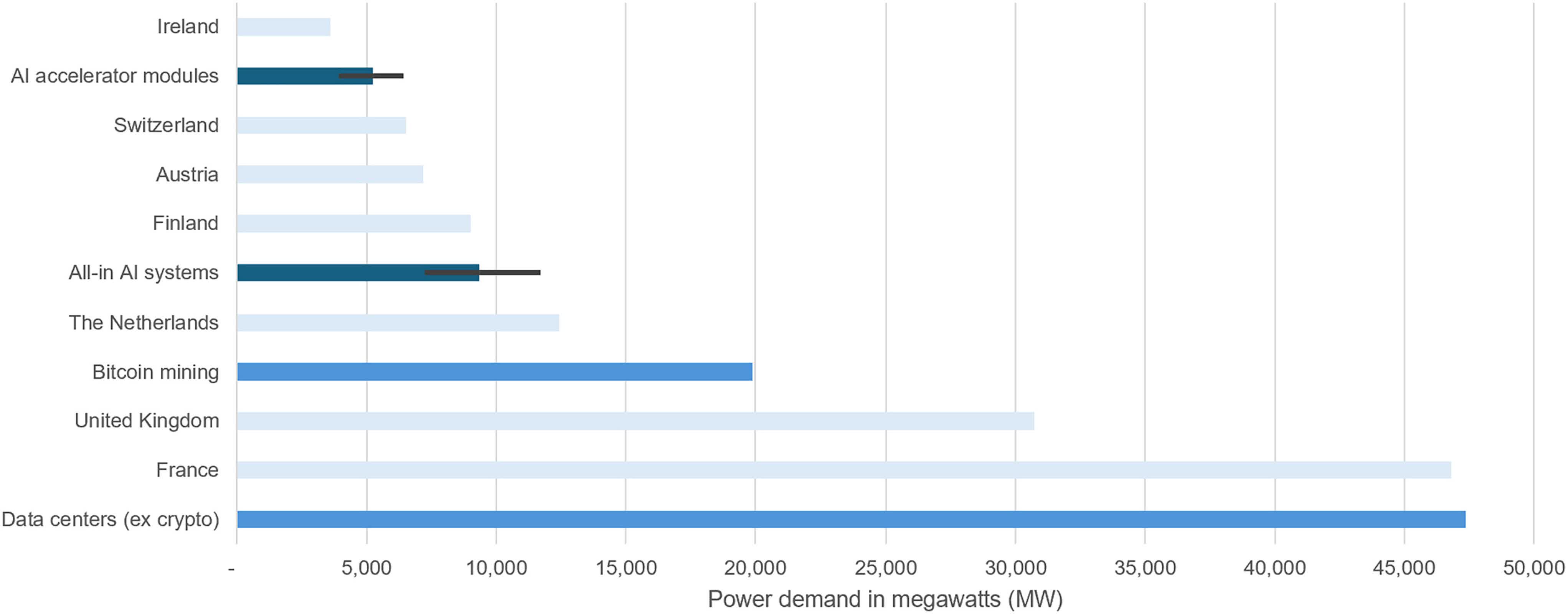

De Vries-Gao estima que el {hardware} producido en 2023-2024 solo podría exigir entre 5.3 y 9.4 gigavatios, lo suficiente como para eclipsar todo el consumo nacional de electricidad de Irlanda.

Pero el verdadero aumento se adelanta. La tecnología de envasado COWOS de TSMC permite que los procesadores potentes y la memoria de alta velocidad se integren en unidades individuales, el núcleo de los sistemas de IA modernos. De Vries-Gao descubrió que TSMC más que duplicó su capacidad de producción de COWOS entre 2023 y 2024, pero la demanda de fabricantes de chips de IA como NVIDIA y AMD aún superaron la oferta.

TSMC planea duplicar la capacidad de COWOS nuevamente en 2025. Si las tendencias actuales continúan, De Vries-Gao proyecta que las necesidades de energía complete del sistema de IA podrían alcanzar 23 gigavatios para fin de año, aproximadamente equivalente al consumo promedio de energía nacional del Reino Unido.

Esto le daría a IA una mayor huella de energía que la minería world de Bitcoin. La Agencia Internacional de Energía advierte que este crecimiento podría duplicar el consumo de electricidad de los centros de datos en dos años.

Si bien las mejoras en la eficiencia energética y una mayor dependencia de la energía renovable han ayudado un poco, estas ganancias están siendo superadas rápidamente por la escala de la implementación de nuevos centros de {hardware} y {hardware}. La mentalidad «más grande es mejor» de la industria, donde se persiguen los modelos cada vez más grandes para aumentar el rendimiento, ha creado un ciclo de retroalimentación para aumentar el uso de recursos. A pesar de que los centros de datos individuales se vuelven más eficientes, el uso normal de energía continúa aumentando.

Detrás de escena, una carrera armamentista de fabricación complica cualquier ganancia de eficiencia. Cada nueva generación de chips de IA requiere un embalaje cada vez más sofisticado. La última tecnología Cowos-L de TSMC, aunque esencial para los procesadores de próxima generación, lucha con bajos rendimientos de producción.

Mientras tanto, compañías como Google informan «disaster de capacidad de potencia» a medida que luchan para construir centros de datos lo suficientemente rápido. Algunos proyectos ahora están reutilizando la infraestructura de combustibles fósiles, y uno obtiene 4.5 gigavatios de capacidad de gasoline pure específicamente para cargas de trabajo de IA.

El impacto ambiental de la IA depende en gran medida de dónde operan estos sistemas hambrientos de energía. En las regiones donde la electricidad se genera principalmente a partir de combustibles fósiles, las emisiones de carbono asociadas pueden ser significativamente más altas que en las áreas alimentadas por las energías renovables. Una granja de servidores en Virginia Occidental, por ejemplo, genera casi el doble de las emisiones de carbono de una en California renovable.

Sin embargo, los gigantes tecnológicos rara vez revelan dónde o cómo opera su IA, una brecha de transparencia que amenaza con socavar los objetivos climáticos. Esta opacidad hace que sea difícil para los responsables políticos, los investigadores y el público evaluar completamente las implicaciones ambientales del auge de la IA.